Llama-3不算真开源:今年10月,权威定义就要来了

你给翻译翻译,什么是开源?

开源大模型的标杆 Llama3,居然都「被闭源」了。今天,开源再次成为了人们讨论的话题。

如今,开源的人工智能算法无处不在,从个人开发者到大型科技公司,大家都在享受最新技术带来的成果。

就连目前最热门的大模型领域,也区分了开源和闭源两个互相竞争的大方向。人们认为,随着开源技术的扩散与交流,开源的大模型最终将赶上 OpenAI 这样的业界顶尖水平。这或许就是扎克伯格等人理想中的繁盛景象。

不过,在层出不穷的新 AI 模型评论区里,我们也经常看到有人吐槽「连权重、数据都没有,这算什么开源?」

这个时候,一家有影响力的机构终于决定站出来,对开源这件事下一个定义了。

今年10月,「真开源」定义就要来了

开放源代码促进会(OSI)最近公布了其对「开源 AI」的最新定义草案。此举旨在澄清 Open Source 这一术语在快速发展的科技领域中,经常出现的模糊用法。

这个定义似乎来的正是时候。一个月前,大模型领域刚刚经历过一轮开源技术更新。Meta 发布了迄今为止最强的开源大模型 Llama3.1405B,宣布所有 Llama 版本的总下载量已超过3亿次,创业公司 Mistral 也紧接着宣布开源了 Large2大模型。

这些公司发布的预训练 AI 语言模型带有权重使用限制,同时继续使用了「开源」标签。这引发了开发者们对 AI 技术背景下什么才是真「开源」的激烈争论。

因为最近一段时间,开源变得越来越像是一个营销术语,将大模型描述为「开源」可以让人们对其变得更加信赖,即使研究人员和开发者时常会被这些许可证所限制。

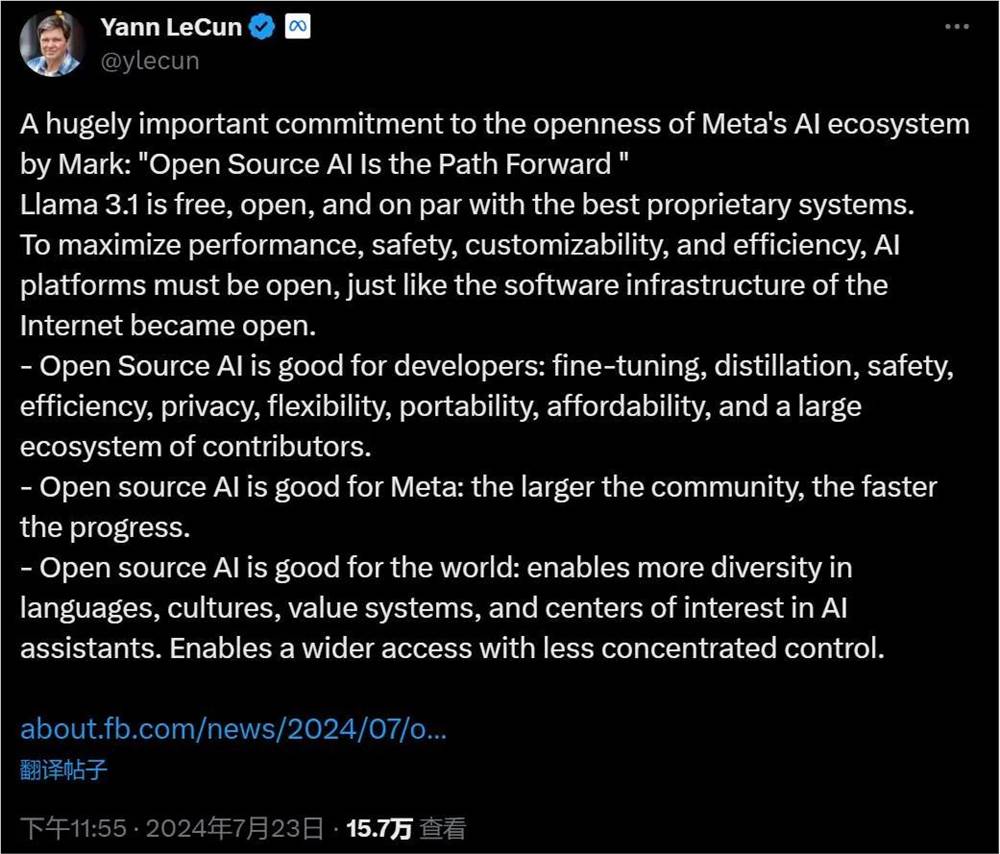

Llama-3.1发布的时候,Yann LeCun 曾宣传了开源的优势。

OSI 给出的定义下,很多事情需要我们来重新审视。例如,Meta 的 Llama3模型虽然可以自由获取,但 Meta 针对使用 Llama 系列模型的公司规模及通过该模型生成的内容类型,设定了特定的许可限制。因此,Llama 不符合 OSI 为软件定义的传统开源标准。

文生图模型 Flux 实际上也不是真正的开源。由于这种模糊性,OSI 通常用「开放权重」或「代码可用」等术语来指代那些含有代码或权重限制或缺乏配套训练数据的 AI 模型。

为了正式解决「真假开源」的问题,一向倡导开源的 OSI 召集了一个专家团队来为「开源」下定义。这个约70人的团队由研究人员、律师、政策制定者组成,其中还有来自 Meta、Google 和亚马逊等大型科技公司的代表。他们起草的最新草案为判断 AI 模型是否符合开源标准提出了「四项基本自由」:不限制使用目的,允许深入研究其工作原理,支持随意修改,无论是否进行过修改都允许用户自由分享模型。

这「四项基本自由」也沿用了人们对开源软件的定义。OSI 希望通过对「开源 AI」树立明确的标准,方便开发者、研究人员和用户在创建、研究或使用 AI 工具做出更明智的决策。

OSI 执行董事 Stefano Maffulli 在 Linux 基金会 AI_dev 大会上发布了对开源定义的最新版草案

换句话说,开源对于 AI 更加稳定安全:如果 AI 模型做到了真正的「开源」,研究人员将能分析 AI 模型背后的工作方式,AI 系统的潜在软件漏洞也将更加明显。相较于 OpenAI 的「闭源」系统 ChatGPT,其确切的架构是一个严格保密的秘密。

据 OSI 的项目时间表显示,他们预计在2024年10月在 All Things Open 会议上正式宣布「开源 AI」定义的最终版。

那么在这个定义下,有哪些大模型是「开源」的呢?据说在第一批名单里包括 EleutherAI 的 Pythia、Ai2的 OLMo 和开源集体 LLM360等。

「创新不应该需要许可」

在五月份的新闻发布会上,OSI 强调了为真正的「开源」AI 厘清定义的重要性。「AI 与常规软件不同,需要迫使所有利益相关者重新审视开源原则对该领域的适用性」,OSI 的执行董事 Stefano Maffulli 说,「OSI 相信每个人都应保有对技术的主导权和控制权。我们还认识到,当定义明确后,它将推动 AI 系统更加透明、更紧密的协作和无需许可的创新,市场就会繁荣发展。」

OSI 的最新草案不止要求「开源」模型本身及其权重,还要求对整个系统更加广义的开放。 一个 AI 系统要想被认定为「开源」,必须提供 OSI 定义的「适合修改的形式」,其中包括训练数据的详细信息、用于训练和运行系统的全部源代码,以及模型权重和参数。这些都必须在 OSI 认可的许可证或条款下提供。

值得注意的是,这份草案并没有强制要求公开原始训练数据。相反,它要求提供关于训练数据和方法的详细元数据。比如数据的来源、选择标准、预处理技术以及其他相关细节,方便研究者重建类似的系统。

这种方法旨在不公开实际数据集的情况下提供透明度和可复制性,在坚持开源原则的同时,从表面上解决了潜在的隐私和版权问题。不过是否能达成预计的效果,可能还有待进一步讨论。

训练数据的来源缺乏透明度,已经导致了一系列针对大型 AI 公司的诉讼。从 OpenAI 这样的业内带头人到 Suno 这样的小应用,这些公司的生成式 AI 产品除了声称包含「可公开访问的信息」外,并未披露太多有关其训练集的信息。很多人呼吁开源模型应该披露所有训练集,不过由于版权和数据所有权等问题,这一标准很难执行。

「这个定义最有趣的是,他们允许不公开训练数据,」独立 AI 研究员 Simon Willison 在接受外媒 Ars Technica 采访时说道:「这是一个非常务实的方法 —— 如果不允许这样,那就几乎就没有模型算『开源』了。」

OSI 想明确「开源」的定义,这个想法可以追溯到2022年,当时它首次开始联系有关组织,邀请他们一起来定义这个术语。

「经过近两年,我们从世界各地征求意见,来确定适合 AI 系统的开源原则,OSI 现在正在全球巡讲,希望能够完善并验证草案中的定义,」Maffulli 表示,「定义『开源』的研讨会仍在进行,现在参与还不晚,可以通过 OSI 网站找到论坛,发表评论建言献策。」

当最终定义在10月揭晓时,新的「开源」AI 定义可能对行业产生深远影响。它将影响公司以何种形式发布 AI 模型,并塑造未来的法规,例如加州备受争议的 SB-1047法案。

希望新的定义,能够进一步推动大模型领域的技术创新。

更新于:3个月前