Qwen-VL体验入口 阿里云视觉语言模型huggingface、github在线使用地址

2024-01-31 13:33

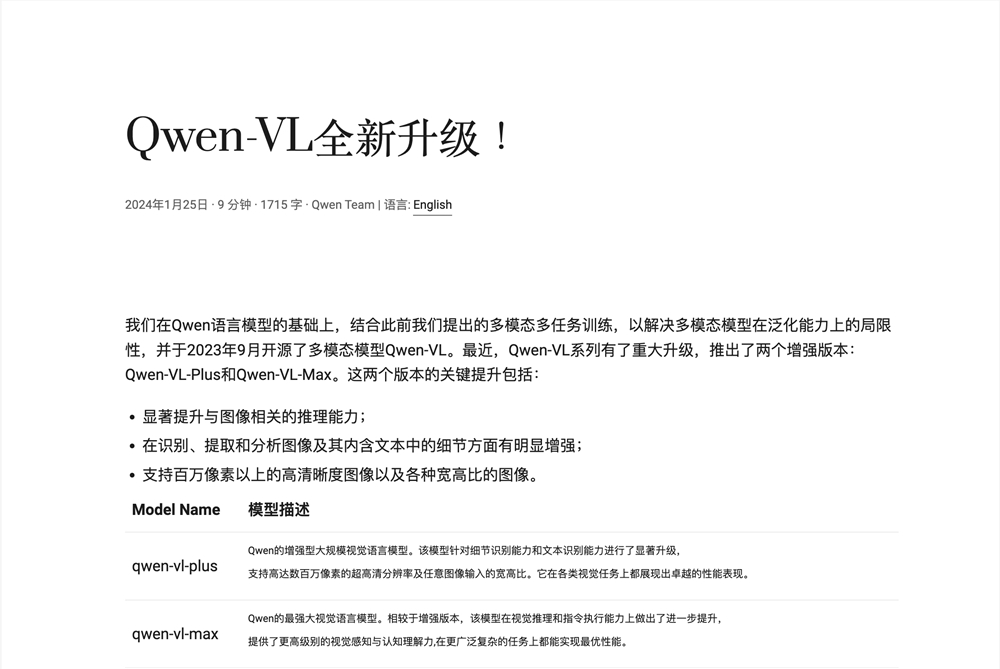

Qwen-VL是阿里云推出的通用型视觉语言模型,具有强大的视觉理解和多模态推理能力。这一创新产品支持零样本图像描述、视觉问答、文本理解、图像地标定位等任务,且在多个视觉基准测试中达到或超过当前最优水平。采用 Transformer 结构,以 7B 参数规模进行预训练,支持 448x448 分辨率,能够端到端处理图像与文本的多模态输入与输出。Qwen-VL的优势在于通用性强、支持多语种、细粒度理解等。它可广泛应用于图像理解、视觉问答、图像标注、图文生成等多个任务。

点击前往Qwen-VL体验入口

Qwen-VL 的使用面向多个人群,包括对图像理解、视觉问答、图像标注、图文生成等任务感兴趣的用户。其强大功能和多语言支持使得它成为解决多种复杂任务的理想选择。

在实际应用中,Qwen-VL提供了零样本图像描述、视觉问答、文本理解、图像地标定位等功能。以下是Qwen-VL的几个产品特色:

零样本图像描述:通过先进的技术,能够从图像中理解并生成相关描述,即便没有任何样本参考。

视觉问答:提供智能的视觉问答功能,用户可以通过图像提出问题,模型能够理解并回答。

文本理解:Qwen-VL能够深入理解文本,对于复杂的语境和多义词有很好的处理能力。

图像地标定位:定位图像中的地标,为地理位置相关的任务提供支持。

Qwen-VL 的应用场景十分广泛,可以应用于图像理解、视觉问答、图像标注、图文生成等众多任务。其多模态推理能力和细粒度理解使得它成为解决复杂问题的得力助手。

想要深入了解Qwen-VL及其强大功能,请访问Qwen-VL网站。

更新于:10个月前

分享